随着 AI SaaS 与大模型应用快速发展,越来越多企业选择使用 Google Kubernetes Engine(GKE)+ GPU 来构建 AI 服务平台,实现:

- 高性能推理

- 自动扩容

- 全球部署

- 成本优化

但在实际部署过程中,常见问题包括:

- GPU 无法正确调度

- 推理服务延迟高

- 多区域部署复杂

本文将从实战角度,完整讲解:

如何使用 GKE + GPU 构建企业级 AI 服务平台

👉 建议先阅读核心架构:

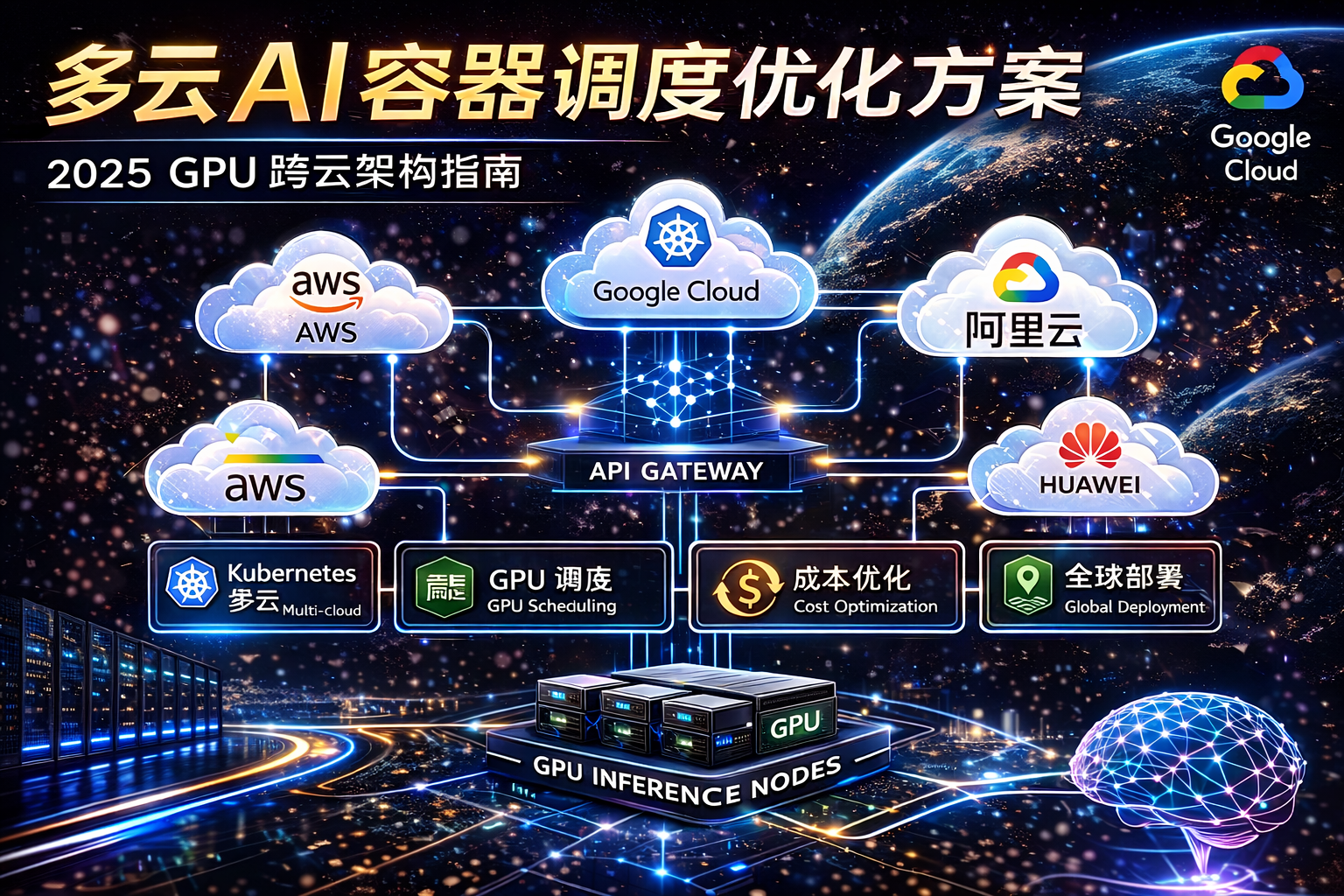

一、为什么选择 GKE 构建 AI 平台?

相比自建 Kubernetes 或其他云厂商:

GKE 优势

✔ 原生 Kubernetes(Google 出品)

✔ GPU 支持成熟

✔ 自动扩容能力强

✔ 与 AI 生态(Vertex AI)深度集成

👉 官方文档:

https://cloud.google.com/kubernetes-engine

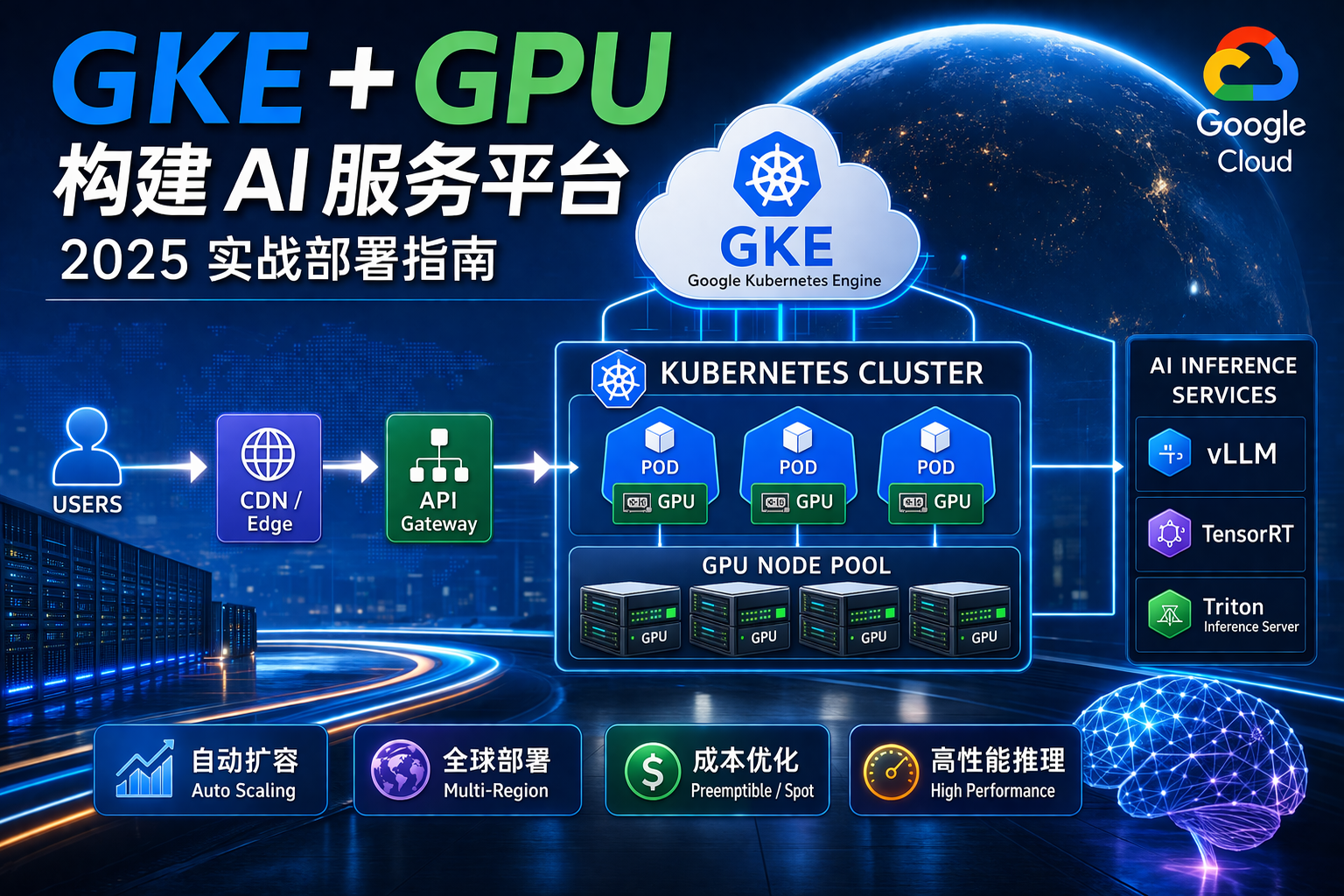

二、GKE + GPU 架构设计

标准 AI 架构如下:

用户 → CDN / Edge → API Gateway → GKE → GPU Pod → 推理服务

核心组件

1️⃣ GKE 集群

- 控制面(Google 托管)

- Node Pool(GPU 节点)

2️⃣ GPU Node Pool

支持 GPU:

- NVIDIA L4

- A100

- H100

👉 官方 GPU 文档:

https://cloud.google.com/compute/docs/gpus

3️⃣ 推理服务

推荐:

- vLLM

- TensorRT

- Triton

4️⃣ API Gateway

- Cloud Endpoints

- API Gateway

三、GKE + GPU 部署流程(实战)

第一步:创建 GKE 集群

gcloud container clusters create ai-cluster

第二步:创建 GPU Node Pool

gcloud container node-pools create gpu-pool \

–cluster ai-cluster \

–accelerator type=nvidia-tesla-a100,count=1

第三步:安装 GPU 驱动

GKE 支持自动安装:

- NVIDIA Driver

- CUDA

第四步:部署推理服务

Kubernetes 示例:

resources:

limits:

nvidia.com/gpu: 1

第五步:暴露 API 服务

使用:

- LoadBalancer

- Ingress

四、自动扩容(核心)

GKE 提供:

1️⃣ Cluster Autoscaler

自动扩容 GPU 节点

2️⃣ HPA

自动扩容 Pod

👉 推荐阅读:

五、GKE AI 平台优化策略

1️⃣ 多区域部署

推荐:

- 新加坡

- 东京

- 欧洲

👉 延迟优化:

2️⃣ GPU 成本优化

策略:

- 使用 Preemptible VM(类似 Spot)

- GPU 混合部署

3️⃣ 推理性能优化

推荐:

- TensorRT https://developer.nvidia.com/tensorrt

- Triton

4️⃣ 缓存与加速

使用:

- Redis

- CDN

六、GKE vs EKS(简单对比)

第五步:暴露 API 服务

使用:

- LoadBalancer

- Ingress

四、自动扩容(核心)

GKE 提供:

1️⃣ Cluster Autoscaler

自动扩容 GPU 节点

2️⃣ HPA

自动扩容 Pod

五、GKE AI 平台优化策略

1️⃣ 多区域部署

推荐:

- 新加坡

- 东京

- 欧洲

2️⃣ GPU 成本优化

策略:

- 使用 Preemptible VM(类似 Spot)

- GPU 混合部署

3️⃣ 推理性能优化

推荐:

- TensorRT https://developer.nvidia.com/tensorrt

- Triton

4️⃣ 缓存与加速

使用:

- Redis

- CDN

六、GKE vs EKS(简单对比)

| 项目 | GKE | EKS |

|---|---|---|

| 易用性 | 高 | 中 |

| GPU支持 | 强 | 强 |

| AI生态 | 强(Vertex AI) | 中 |

| 全球节点 | 强 | 强 |

七、企业级架构推荐

用户

↓

CDN / Edge

↓

API Gateway

↓

GKE

↓

GPU Node Pool

↓

推理服务

八、常见问题

GPU 无法使用

原因:

- Node Pool 未配置 GPU

推理延迟高

原因:

- 没有多区域部署

成本过高

原因:

- 没用 Preemptible

九、最佳实践总结

✔ 使用 GKE GPU Node Pool

✔ 配置自动扩容

✔ 多区域部署

✔ API 网关统一入口

✔ CDN 加速

📌 总结

GKE 是构建 AI 服务平台的最佳选择之一,特别适用于:

- AI SaaS

- AI 出海

- 全球 AI 应用

如果你希望:

- 快速部署 AI 服务

- 降低 GPU 成本

- 实现全球扩展

👉 推荐参考: