随着生成式 AI 和大模型应用的快速普及,越来越多企业开始自建 AI 推理服务,例如:

- AI Chatbot

- AI 文生图

- AI 视频生成

- AI 搜索引擎

但在部署之前,企业面临一个核心问题:

大模型推理服务器到底应该如何选型?

如果你还没有了解完整部署流程,建议先阅读:

👉 《企业如何部署 AI 推理服务器?(完整指南)》

https://www.91-cloud.com/blog/2026/02/28/ai-inference-server-deployment/

本文将从 GPU 类型、显存需求、服务器配置、成本控制 四个维度,帮助企业选择最合适的大模型推理服务器。

一、大模型推理服务器与训练服务器的区别

很多企业容易混淆:

训练服务器

特点:

- GPU 数量多

- 显存需求极高

- 计算密集

推理服务器

特点:

- 延迟要求高

- 并发要求高

- 成本敏感

推理服务器更强调:

- 稳定性

- 自动扩容

- API 服务能力

二、大模型推理服务器核心配置

企业在选型时主要关注 4 个指标。

1️⃣ GPU 类型

常见 GPU:

| GPU | 显存 | 适用模型 |

|---|---|---|

| L4 | 24GB | 中小模型 |

| A10 | 24GB | 推理服务 |

| A100 | 40/80GB | 大模型 |

| H100 | 80GB | 超大模型 |

参考:

NVIDIA Data Center GPU

https://www.nvidia.com/en-us/data-center

2️⃣ GPU 显存

显存决定模型规模。

例如:

| 模型规模 | 显存需求 |

|---|---|

| 7B | 16GB |

| 13B | 24GB |

| 30B | 40GB |

| 70B | 80GB |

显存不足会导致:

- 推理速度下降

- OOM 错误

3️⃣ CPU 与内存

虽然 GPU 是核心,但 CPU 也很重要。

推荐:

| 模型 | CPU | 内存 |

|---|---|---|

| 中小模型 | 8 Core | 32GB |

| 中型模型 | 16 Core | 64GB |

| 大模型 | 32 Core | 128GB |

4️⃣ 存储与网络

推理服务器通常需要:

- NVMe SSD

- 高带宽网络

- 低延迟访问

企业出海应用还需要:

- 全球节点

- CDN 加速

- 边缘网络

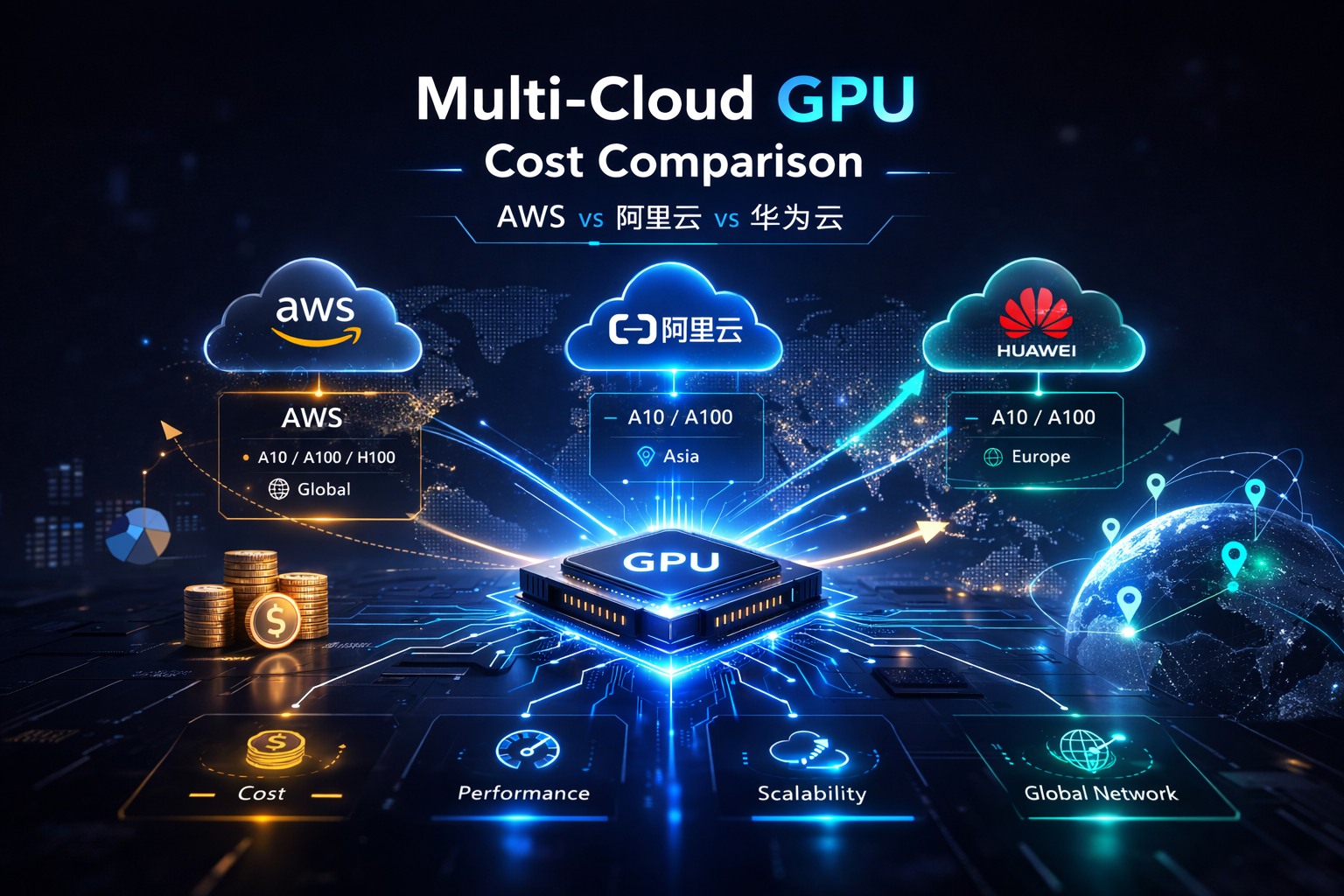

三、主流云厂商 GPU 选型建议

不同云厂商 GPU 资源存在明显差异。

详细成本对比可以参考:

👉 《多云 GPU 成本对比:AWS / 阿里云 / 华为云》

AWS

优点:

- GPU 型号最全

- 全球节点最多

- 支持 Spot 实例

GPU 实例参考:

https://aws.amazon.com/ec2/instance-types/#Accelerated_Computing

适合:

- 全球 AI SaaS

- AI 出海产品

阿里云

优势:

- 亚洲价格优势明显

- 中国节点丰富

GPU 产品:

https://www.alibabacloud.com/product/ecs/gpu

适合:

- 亚洲 AI 产品

- 国内 AI 平台

华为云

优势:

- 欧洲市场优势

- 政企合规能力强

GPU 产品:

https://www.huaweicloud.com/intl/en-us/product/gpu-server.html

适合:

- 欧洲 AI 应用

- 企业级 AI 平台

四、不同模型推荐服务器配置

7B 模型

推荐配置:

- GPU:L4 / A10

- 显存:24GB

- CPU:8 Core

- 内存:32GB

适合:

- AI Chatbot

- AI 搜索

13B 模型

推荐:

- GPU:A10 / A100

- 显存:40GB

适合:

- AI 助手

- 企业 AI 客服

70B 模型

推荐:

- GPU:H100

- 多 GPU 集群

适合:

- 大规模 AI SaaS

- AI API 平台

五、大模型推理服务器成本控制

企业部署 AI 推理服务器时,建议采用:

自动扩缩容

高峰扩容

低峰缩容

多云部署

不同区域使用不同云。

GPU 混合部署

小模型使用 L4

大模型使用 A100

六、企业级部署架构建议

推荐架构:

用户请求

↓

API Gateway

↓

负载均衡

↓

GPU 推理节点

↓

对象存储

详细架构可参考:

七、常见选型误区

企业经常犯的错误:

只看 GPU 不看带宽

网络延迟会影响推理速度。

GPU 配置过高

导致成本失控。

没有自动扩容

导致高峰服务崩溃。

八、总结

大模型推理服务器选型核心原则:

1️⃣ 模型规模决定 GPU

2️⃣ 显存决定推理能力

3️⃣ 网络决定延迟

4️⃣ 自动扩容控制成本

如果企业希望:

- 部署 AI 推理平台

- 构建全球 AI 服务

- 优化 GPU 成本

建议参考 91CLOUD 多云部署方案: