随着大模型与生成式 AI 的普及,越来越多企业开始自建 AI 推理服务,而不是完全依赖第三方 API。

但问题来了:

- 如何选择 GPU?

- 如何部署高可用架构?

- 如何控制成本?

- 如何全球加速?

本指南将系统讲解 AI 推理服务器的部署流程、架构设计、成本优化与全球部署策略,帮助企业构建稳定、可扩展的 AI 推理平台。

一、什么是 AI 推理服务器?

AI 推理服务器指的是:

用于运行已训练模型、对外提供实时推理服务的计算环境。

它通常具备:

- GPU 加速能力

- 高并发支持

- 低延迟响应

- API 服务化接口

与“模型训练服务器”不同,推理更强调:

- 响应速度

- 稳定性

- 成本控制

二、部署 AI 推理服务器前必须明确的 5 个问题

1️⃣ 并发量

- 每秒请求数 QPS?

- 峰值流量?

2️⃣ 模型规模

- 7B / 13B / 70B?

- 显存需求?

3️⃣ 延迟要求

- <100ms?

- <1 秒?

4️⃣ 是否需要全球部署?

- 是否面向海外用户?

5️⃣ 是否多云容灾?

- 是否需要跨云架构?

如果涉及跨云与容灾,可参考:

多区域灾备架构设计

https://www.91-cloud.com/blog/2026/02/26/multi-region-disaster-recovery/

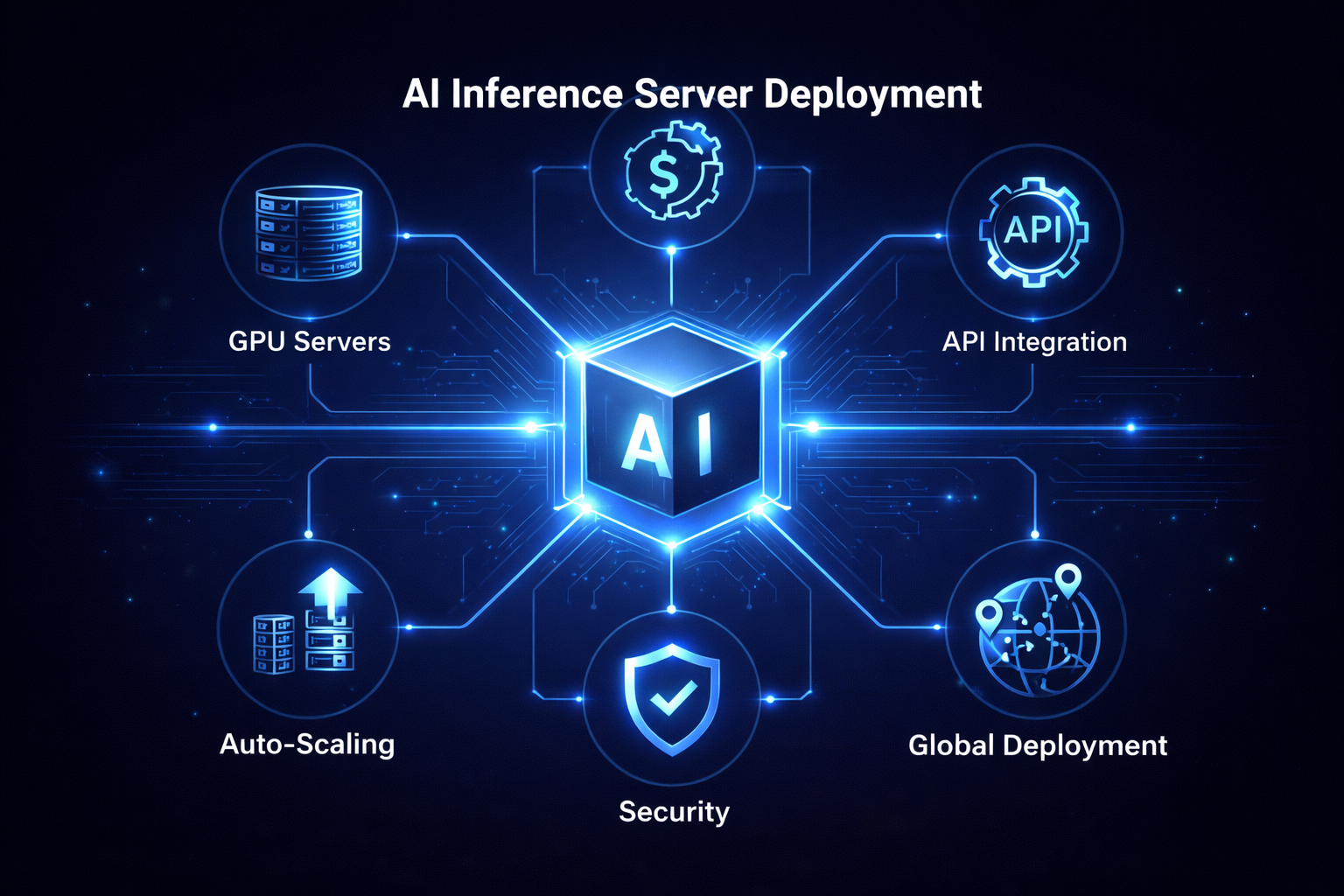

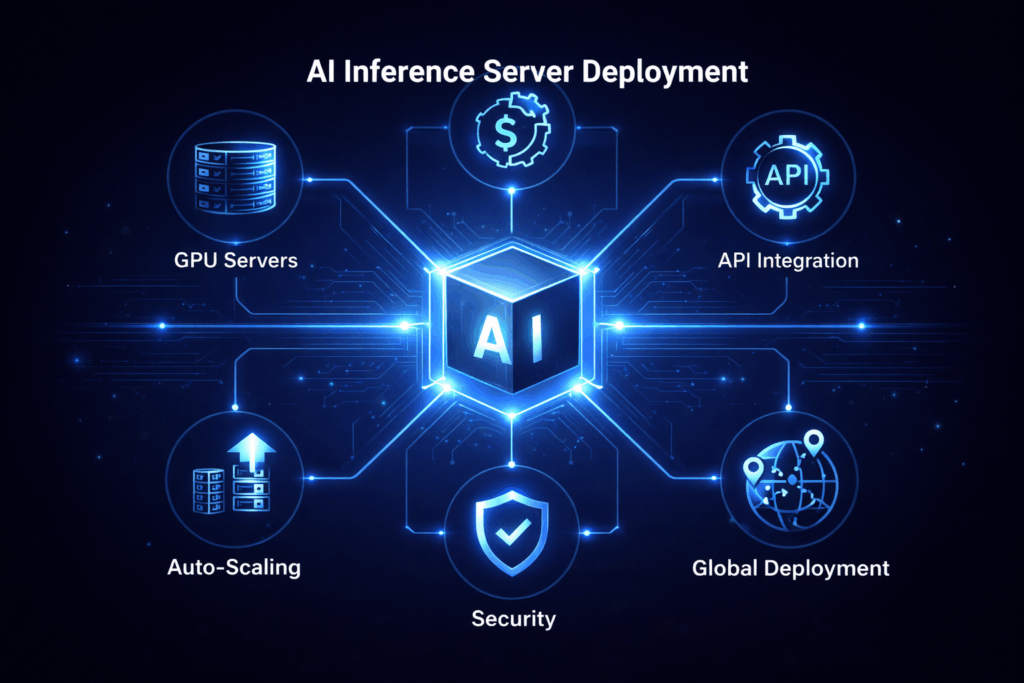

三、AI 推理服务器的典型架构

标准架构通常包含:

用户 → API 网关 → 负载均衡 → GPU 推理节点 → 存储 → 日志系统

核心组件:

- API Gateway

- 负载均衡

- GPU 实例

- 对象存储

- 监控系统

后续详细架构将在:

《大模型 API 网关架构设计》

(后续专题文章)

四、如何选择 GPU 实例?

这是企业最关心的问题。

常见选择

- NVIDIA A10

- NVIDIA A100

- NVIDIA H100

- L4

选择原则:

- 模型大小决定显存

- QPS 决定 GPU 数量

- 延迟决定部署区域

详细成本对比请参考:

《多云 GPU 成本对比:AWS / 阿里云 / 华为云》

(专题内链文章)

五、单区域 vs 多区域部署

单区域部署

优点:

- 成本低

- 管理简单

缺点:

- 故障风险高

多区域部署

优点:

- 高可用

- 全球加速

涉及跨云架构可参考:

混合云部署指南

https://www.91-cloud.com/blog/2026/01/05/gcp-hybrid-connect-guide/

六、AI 推理服务器如何实现高可用?

推荐架构:

- 多 GPU 节点

- 自动扩容

- 健康检查

- 灰度发布

相关扩展阅读:

《GPU 实例如何实现自动扩容?》

(专题文章)

《AI 服务灰度发布实践》

(专题文章)

七、全球用户如何降低延迟?

企业出海时必须考虑:

- 全球 DNS 调度

- CDN 加速

- 边缘部署

- 专线优化

详细方案可参考:

AI 应用如何全球加速?

(专题文章)

八、AI 推理服务器成本控制策略

1️⃣ 混合 GPU 策略

高峰期高配,低峰期降配。

2️⃣ 自动扩缩容

3️⃣ 负载拆分

大模型与小模型分离。

4️⃣ 多云比价部署

详见:

《多云 GPU 成本对比》

(专题文章)

九、安全与合规问题

AI 推理服务器必须考虑:

- API 限流

- DDoS 防护

- 模型访问控制

- 数据加密

后续文章:

《大模型 API 安全防护策略》

《AI 服务如何防 DDoS?》

十、企业级部署建议总结

推荐部署路径:

阶段一:单区域 GPU 部署

阶段二:加入自动扩容

阶段三:多区域高可用

阶段四:跨云容灾

十一、为什么企业越来越选择多云 AI 架构?

原因包括:

- 成本差异

- 区域覆盖

- 合规需求

- 避免单云锁定

后续专题:

《多云 AI 容器调度优化方案》

十二、总结

部署 AI 推理服务器,不只是“买 GPU”。

它涉及:

- 架构设计

- 成本控制

- 高可用策略

- 全球加速

- 安全合规

如果你希望构建:

- 企业级 AI 推理平台

- 多云高可用架构

- 全球部署方案

可参考 91CLOUD 多云实践经验:

📚 官方参考与延伸阅读

- NVIDIA Data Center GPUs https://www.nvidia.com/en-us/data-center/

- Amazon EC2 GPU Instances https://aws.amazon.com/ec2/instance-types/#Accelerated_Computing

- Google Cloud GPU Documentation https://cloud.google.com/compute/docs/gpus

- Kubernetes Official Documentation https://kubernetes.io/docs/

- NVIDIA TensorRT Optimization Guide https://developer.nvidia.com/tensorrt